Zwei Tauben picken Körner auf einer Grünfläche in Konstanz. Eine dritte Taube landet in der Nähe. Vier Kameras sind um die Fläche aufgestellt. Die Doktoranden Alex Chan und Urs Waldmann vom Exzellenzcluster Kollektives Verhalten an der Universität Konstanz nehmen die Szene auf. Zurück im Büro modellieren sie auf Basis des Filmmaterials mit einem Computer Vision-System die Körperhaltung der Tiere, stellen deren Identität fest und analysieren ihre Bewegungen. Das System erkennt automatisch alle Tauben im Bild und zeichnet einen rechteckigen Rahmen um das Tier. Es erfasst zentrale Körperteile und die Körperhaltung der Tiere sowie deren Position und Interaktionen mit den anderen Tauben. All das ist möglich, ohne dass auch nur ein einziger Marker an einem Tier angebracht werden musste. Auch sonst fand keinerlei menschliche Einflussnahme auf die Tiere statt. Bis vor Kurzem wäre das noch nicht möglich gewesen.

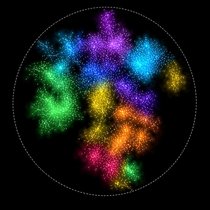

System zur 3D-Modellierung und Erfassung der Körperhaltung von bis zu zehn Tauben

In jüngster Zeit jedoch ist die Entwicklung von computergestützten Methoden, die die Körperhaltungen von Tieren und deren Bewegungen auswerten, enorm fortgeschritten. Es fehlten jedoch Systeme und Benchmarks für die 3D-Erfassung der Bewegungen von Tiergruppen. Genau an dieser Stelle setzten Forschende des Exzellenzclusters Kollektives Verhalten an der Universität Konstanz und des Max-Planck-Instituts für Verhaltensbiologie mit ihrem 3D-MuPPET-System an, welches mit den Aufnahmen von mehreren Kameras die Körperhaltung und Bewegung von bis zu zehn Tauben gleichzeitig in drei Dimensionen modelliert und nachverfolgt. Ihre Ergebnisse wurden kürzlich in der Fachzeitschrift International Journal of Computer Vision (IJCV) veröffentlicht.

Wichtiger Schritt für die Nachverfolgung von Tierbewegungen und die automatische Verhaltensanalyse

3D-MuPPET ist ein Computervision-System, das auf Basis der Aufnahmen von vier Kameras die Körperhaltung und Identität von bis zu zehn einzelnen Tauben nachverfolgen kann – und das für Daten, die sowohl im Labor als auch in freier Wildbahn gesammelt wurden. „Wir haben einen 2D-Keypoint-Detektor trainiert und diese Punkte in 3D übertragen. Außerdem haben wir gezeigt, dass Modelle, die auf Basis von Daten zu einzelnen Tauben entwickelt wurden, auch gut mit den Daten vom mehreren Tauben umgehen können“, beschreibt Urs Waldmann.

Damit bietet das System eine konkrete Methode für Biolog*innen, um Experimente zu erstellen und die Körperhaltung von bis zu zehn Tieren für die automatische Verhaltensanalyse zu messen. „Dieses System ist ein wichtiger Meilenstein in der Erfassung der Körperhaltungen von Tieren und der automatischen Verhaltensanalyse", so Alex Chan und Urs Waldmann.

Auch in freier Wildbahn einsetzbar

Sowohl in Innenräumen als auch in der Natur – dort allerdings bisher nur mit bis zu drei Tieren – kann 3D-MuPPET die Bewegungen von Tauben nachverfolgen. „Wir haben das ‚Segment Anything Model‘ verwendet, das den Umriss eines beliebigen abgebildeten Objekts identifizieren kann. Dann haben wir einen 2D-Keypoint-Detektor mit Innenaufnahmen einer ausgeschnittenen Taube trainiert, bevor wir das Model für die Analyse von Taubenfotos aus der freien Wildbahn verwendet haben. Hierfür waren keine zusätzlichen Modell-Optimierungen notwendig“, erläutert Alex Chan.

3D-MuPPET ist eine der ersten Fallstudien zur Frage, wie ein fließender Übergang von der Erforschung von Tierbewegungen im Labor zu deren Erforschung in freier Wildbahn gelingt. Dies bereitet die Bühne für detaillierte Beobachtungen von Tierverhalten im natürlichen Lebensraum. Die hierfür entwickelten Methoden können, so die Forscher, künftig auch auf andere Tierarten ausgeweitet werden. Mögliche Anwendungen liegen beispielsweise in der groß angelegten Erforschung kollektiven Verhaltens und dem Monitoring einzelner Tierarten.

3D-MuPPET bietet somit ein leistungsfähiges und flexibles System für Forschende, die mit Unterstützung der 3D-Rekonstruktion von der Körperhaltung einzelner Tiere das kollektive Verhalten von einer beliebigen Tierart überall erforschen möchten. Es bedarf lediglich mehrerer Kameras und eines Tools zur 2D-Modellierung von Tierkörperhaltungen, damit das System auch die Körperhaltungen beliebiger Tiere in drei Dimensionen nachverfolgen kann.

Universität Konstanz

Originalpublikation:

Waldmann, U. & Chan, A.H.H. et al. 3D-MuPPET: 3D Multi-Pigeon Pose Estimation and Tracking. Int J Comput Vis (2024). DOI: https://doi.org/10.1007/s11263-024-02074-y